Em 2026, o Brasil chega às urnas em um cenário inédito: a inteligência artificial generativa já faz parte do cotidiano e passou a disputar, em escala industrial, o território das narrativas. Áudios, vídeos e imagens hiper-realistas tornam a desinformação mais sofisticada, emocional e difícil de detectar.

A fronteira entre o real e o fabricado nunca foi tão frágil e, por isso mesmo, a comunicação deixa de ser apenas instrumento político para se tornar, mais do que nunca, pilar da própria democracia. Nesse novo ambiente informacional, não basta mais perguntar se algo é verdadeiro ou falso.

A questão central passa a ser: Quem produziu? Com que tecnologia? Com qual intenção e para qual público? As eleições não serão apenas uma disputa entre candidatos, mas um teste estrutural da capacidade da sociedade de reconhecer, interpretar e reagir à informação em um ecossistema mediado por máquinas, plataformas e algoritmos.

Mais do que nunca, a política passa a ser travada no campo simbólico. Narrativas, enquadramentos e emoções ganham peso semelhante, ou maior do que propostas, programas e dados objetivos. A tecnologia amplia vozes, porém também aumenta ruídos. E, nesse cenário, a Comunicação deixa de ser coadjuvante para ocupar o centro da engrenagem democrática.

Dados preocupantes

Segundo a Agência Lupa, o uso de IA para a produção de conteúdos falsos cresceu de forma expressiva no Brasil. Um estudo do Observatório Lupa aponta que deepfakes e outras peças desinformativas geradas com IA saltaram de 39 casos em 2024, o equivalente a 4,6% do total de checagens realizadas naquele ano, para 159 registros em 2025, representando 25% das verificações.

O aumento é de 120 ocorrências, uma variação de 20,4 pontos percentuais, o que corresponde a um crescimento aproximado de 308% no número absoluto de casos. Os dados integram o 1º Panorama da Desinformação no Brasil, pesquisa anual conduzida pela Lupa que mapeia os conteúdos falsos de maior circulação no ambiente digital brasileiro.

O levantamento identifica tendências, principais alvos e estratégias recorrentes utilizadas na disseminação de desinformação. Na edição inaugural, o estudo aponta uma mudança estrutural no ecossistema desinformativo.

Se em 2024 a IA era empregada majoritariamente na criação de golpes digitais, como deepfakes de celebridades promovendo sites fraudulentos, em 2025 a tecnologia passou a ser utilizada de maneira mais estratégica no campo político. Quase 45% dos conteúdos produzidos com IA apresentaram viés ideológico, ante 33% no ano anterior, indicando uma ampliação do uso da ferramenta como instrumento de disputa política.

A IA como motor de escala

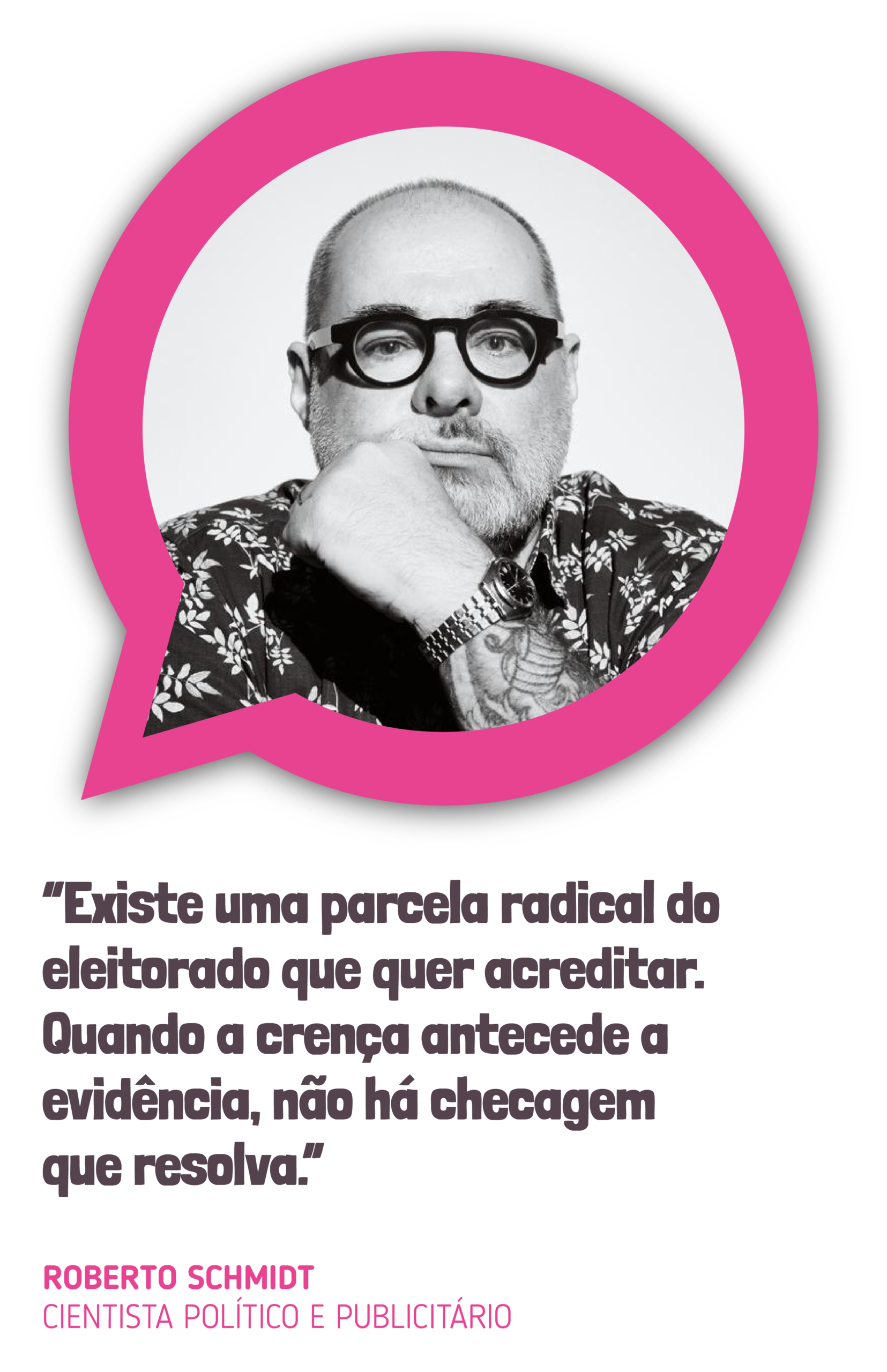

Para o cientista político e publicitário Roberto Schmidt, a IA não entra em 2026 como novidade, mas como maturidade. “Ela já estreou em 2022. O que veremos agora é um estágio mais consolidado. Já existe legislação, ainda que incipiente, e uma parcela do eleitorado aprendeu a desconfiar do que recebe.”

Segundo ele, do ponto de vista jurídico, os tribunais não estão desarmados. O desafio é que a tecnologia evolui em ciclos exponenciais, enquanto o Direito avança em passos processuais.

Na prática, a grande transformação está na escala. “A IA acelera produção, reduz custo, organiza dados, segmenta mensagens e permite testar narrativas em tempo real. A caixa de Pandora foi aberta. Não há possibilidade realista de fechá-la.”

Ao mesmo tempo, Schmidt identifica um elemento democratizante: campanhas com menos recursos passam a acessar ferramentas antes restritas a grandes estruturas. Para ele, o debate não deve ser sobre proibição, mas sobre responsabilização. “O problema não é a ferramenta, é o uso deliberado para enganar.”

Ainda assim, há um ponto mais delicado: a veracidade deixou de ser apenas um debate factual. “Existe uma parcela radical do eleitorado que quer acreditar. Quando a crença antecede a evidência, não há checagem que resolva.”

A política contemporânea, afirma ele, disputa não apenas informação, mas também pertencimento e significado. A inteligência artificial amplia de modo radical a produção e a circulação de conteúdos políticos. Campanhas tornam-se mais rápidas, mais baratas e mais personalizadas.

A microssegmentação permite que mensagens diferentes cheguem a públicos distintos com precisão quase invisível, moldadas a partir de dados comportamentais, históricos de navegação e perfis psicológicos.

Se antes a propaganda falava com “massas”, agora fala com “bolhas”. Cada eleitor pode receber uma versão distinta da realidade, ajustada ao seu repertório emocional, às suas crenças e até às suas fragilidades. A automação da persuasão acelera a desinformação e multiplica o impacto do erro, ou da mentira.

Para a Justiça Eleitoral, o risco é claro. Segundo o secretário judiciário do Tribunal Regional Eleitoral do Rio Grande do Sul (TRE-RS), Rogério de Vargas, a propaganda irregular pode ser “turbinada” com IA.

“Ela pode ser enganosa, injuriosa e até criminosa. O dano é imediato e grande. O desafio se amplia porque qualquer cidadão pode usar a IA para apoiar candidatos, o que dificulta a fiscalização”, ressalta.

Além disso, a própria noção de autoria se dilui. Quem responde por um vídeo falso criado por um apoiador anônimo? Como identificar a origem de um áudio sintético que circula em grupos fechados? O ecossistema da IA tensiona o direito eleitoral, os mecanismos de controle e a própria ideia de responsabilidade.

Checar já não basta

Se antes o foco era descobrir se algo era falso, agora o desafio é maior: explicar como e por que determinado conteúdo foi produzido. Deepfakes, áudios sintéticos e vídeos hiper-realistas tornam a checagem binária (falso x verdadeiro) insuficiente. O problema não é só a mentira, mas também o enquadramento, a edição e a circulação estratégica.

Para Rogério de Vargas, a própria lógica da propaganda irregular mudou. “Antes, esse tipo de prática estava muito mais restrito às ruas. Hoje, ela migrou quase totalmente para as redes sociais”, afirma. Nesse ambiente digital, a desinformação ganha velocidade, escala e sofisticação técnica, tornando o dano mais rápido e mais difícil de conter.

Para a jornalista Ana Flor, colunista do g1 e comentarista da GloboNews, a cobertura exige vigilância permanente. “Os veículos estão se preparando com regras claras de conduta e procedimentos para checar informações. Sem dúvida, é preciso questionar tudo”, salienta.

Conforme ela, mostrar se algo é falso já faz parte da rotina, porém alertar a audiência precisa ser constante. “Isso só reforça a importância do Jornalismo profissional como porto seguro.”

A confiança como ativo

Jornalismo, Marketing Político e Publicidade passam a ocupar papéis distintos e mais sensíveis. O primeiro atua como mediador da realidade. O segundo precisa lidar com limites éticos mais rígidos no uso da IA. A publicidade transita entre estratégia, persuasão e responsabilidade social. As fronteiras entre comunicação legítima e manipulação tornam-se mais tênues.

Em um ambiente em que tudo pode ser fabricado, a confiança vira ativo estratégico. Para a jornalista e especialista em Reputação e Gestão de Crise Soraia Hanna, o papel da Comunicação na preservação da confiança pública durante as eleições é decisivo.

“Os momentos eleitorais são sempre um desafio para os veículos de comunicação. Principalmente porque, mesmo com protocolos e códigos de conduta bem estruturados junto às equipes, as interpretações de parte a parte nem sempre condizem com a realidade”, opina. Para ela, manter o equilíbrio deve ser o objetivo permanente.

Soraia recomenda que os veículos adotem uma postura clara antes mesmo do início das campanhas. “Dar ampla transparência ao posicionamento do veículo antes de começar as campanhas funciona como uma vacina para as pressões que entram normalmente em campo.”

Segundo ela, isso vale tanto no relacionamento com as equipes de campanha quanto para os eleitores, os quais podem ser alvo de narrativas de desconstrução do papel da mídia. “Regras e critérios claros, muito diálogo e respeito, sobretudo aos cidadãos como protagonistas do grande evento democrático, são pontos essenciais para a preservação da confiança”, reforça.

Em um cenário em que tudo pode ser questionado, o que sustenta a reputação não é apenas a velocidade, mas a coerência ao longo do tempo. “A essência e a verdade repetidas com consistência, mas de uma forma compreensível para alcançar o público-alvo.”

Para ela, isso reforça a importância da valorização de uma comunicação profissional, apta a construir o melhor conteúdo no formato mais adequado à estratégia em curso, com transparência, técnica e disciplina.

Schmidt enfatiza que o limite ético do uso da IA não começa na tecnologia, mas na intenção. “Existem leis e existem balizas profissionais que não são meramente decorativas.” Ele cita o Código de Ética do Clube Associativo dos Profissionais de Marketing Político (CAMP) como exemplo de orientação que delimita o debate aos argumentos e à informação, servindo simultaneamente aos interesses dos clientes e da população.

Para ele, utilizar IA para organizar dados ou qualificar a comunicação não é problema. “Quando a ferramenta organiza, esclarece e amplia o acesso à informação, ela qualifica a democracia.” A ruptura ocorre quando há intenção de enganar. “Se é usada para fabricar uma realidade paralela para induzir o eleitor ao erro, rompe não apenas um código de ética, mas o próprio contrato democrático.”

A desinformação, lembra, sempre existiu. O que mudou foi a escala. “O que antes exigia estrutura sofisticada, hoje pode ser feito em qualquer celular. A mentira sempre esteve presente na política; agora, ela ganhou capacidade industrial de multiplicação.”

Novas regras

As eleições gerais de 2026 serão as primeiras realizadas sob as regras da norma do Tribunal Superior Eleitoral (TSE) que disciplina o uso de IA na propaganda de partidos, coligações, federações, candidatas e candidatos. A Resolução TSE nº 23.732/2024, criada para as eleições municipais de 2024, proíbe o uso de deepfakes, conteúdos falsos produzidos por IA, com manipulação hiper-realista de rostos e vozes, frequentemente utilizados para atacar, enganar ou desacreditar pessoas.

A norma também estabelece a obrigatoriedade de informar quando houver uso de IA na propaganda eleitoral, limita a utilização de robôs para intermediar o contato com eleitores e prevê a responsabilização de grandes plataformas digitais que não removerem conteúdos com desinformação, discurso de ódio ou apologia a ideologias nazista e fascista, além de manifestações antidemocráticas, racistas ou homofóbicas.

Novas competências para um novo pleito

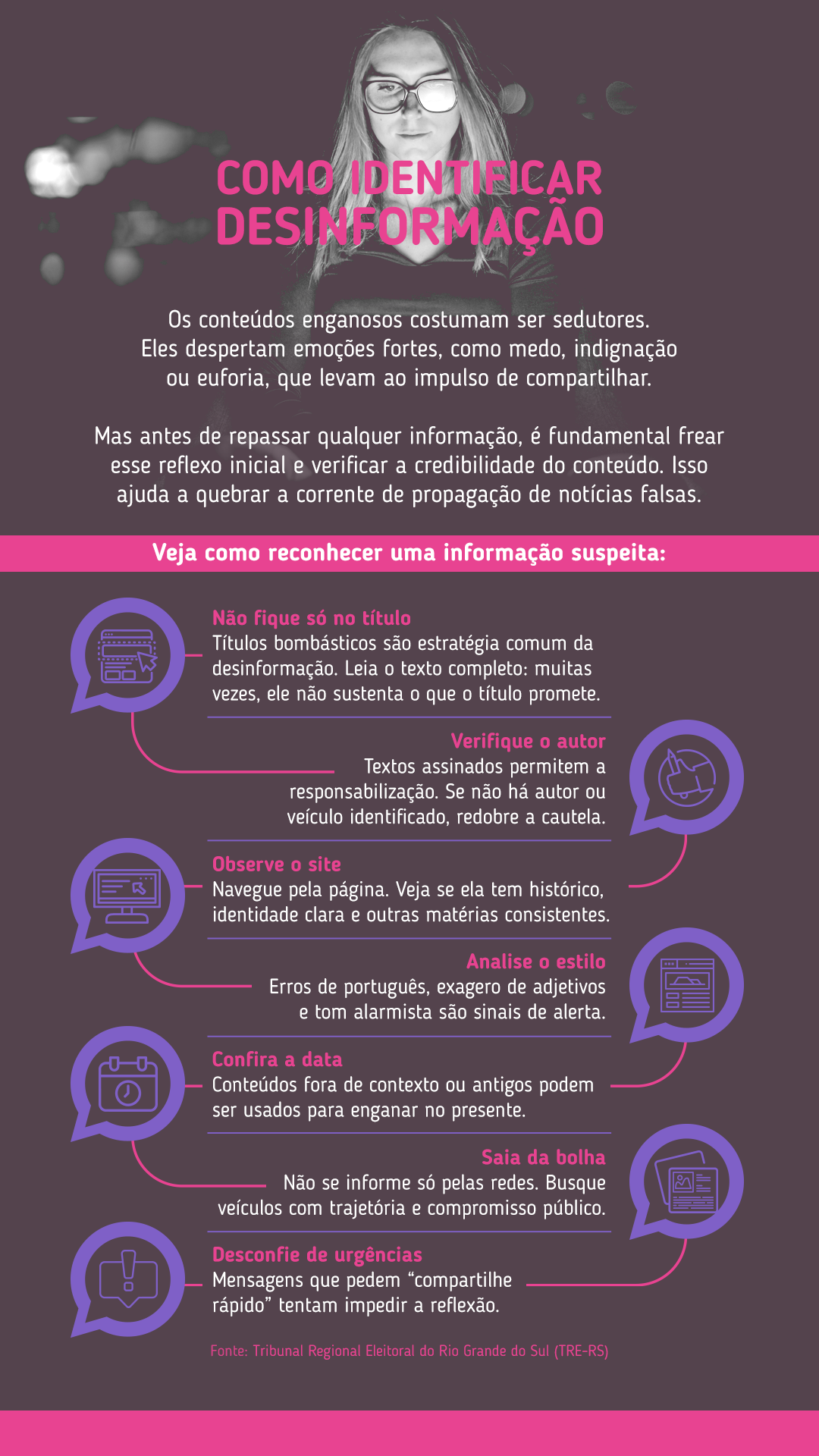

A IA exige novos processos, códigos e habilidades. O TRE-RS atua a partir de um tripé: prevenção, educação e repressão. Rogério de Vargas destaca que a educação midiática é uma frente estratégica e de longo prazo.

“Trabalhamos com educação midiática há muito tempo. Em parceria com a Associação Gaúcha de Emissoras de Rádio e Televisão (Agert) e com os meios de Comunicação, desenvolvemos programas em escolas, além de ações no nosso Memorial. Esse é um trabalho contínuo, que forma cidadãos mais atentos e críticos.”

Para Vargas, esse esforço só faz sentido se for permanente e articulado com a sociedade. “Não adianta agir apenas em ano eleitoral. A educação para o consumo crítico da informação precisa acontecer antes, durante e depois das eleições”, ressalta.

De acordo com ele, a parceria com a Agert é estratégica porque aproxima a Justiça Eleitoral dos veículos regionais, das rádios e dos comunicadores que têm contato direto com a população. “São esses profissionais que ajudam a traduzir o que é permitido, o que é irregular e por que a desinformação é um risco coletivo”, diz. Nesse sentido, a Comunicação deixa de ser somente e passa a ser também ferramenta pedagógica da democracia.

Além disso, o Tribunal realiza capacitações com servidores e com a Polícia Federal para criar cenários e construir respostas rápidas contra ilícitos informacionais. “A PF é uma parceira essencial nesse processo. Atuamos juntos para afastar qualquer tipo de irregularidade, principalmente aquelas ligadas à desinformação”, afirma.

Segundo ele, nas eleições municipais de 2024, o uso de deepfakes não foi protagonista. “Mas agora é diferente. Em uma eleição de âmbito nacional, com menos candidatos e mais recursos envolvidos, a tendência é que essas tecnologias entrem em cena com mais força.”

Quando o assunto é preparo para ataques com deepfakes e manipulação sintética, Schmidt assegura que a defesa não é só tecnológica. “Campanhas não se preparam apenas com software. Se preparam com verdade.” Para ele, o eleitor percebe quando algo soa artificial, mas, muitas vezes, escolhe acreditar na narrativa que confirma suas convicções. “O desafio não é apenas técnico: é emocional.”

A melhor blindagem continua sendo uma comunicação clara, direta e consistente. “Transparência não como slogan, mas como método. Respostas rápidas, linguagem simples, posicionamento objetivo.” Em tempos de manipulação digital, diz ele, a autenticidade virou ativo eleitoral. “Deepfakes prosperam na ambiguidade e no silêncio. Campanhas que cultivam proximidade reduzem o espaço onde a mentira cresce.”

Para agências, veículos e profissionais, isso significa revisar códigos de conduta, ser transparente sobre o uso de IA e assumir a alfabetização midiática como responsabilidade institucional. Em 2026, comunicar não será somente convencer. Será, sobretudo, sustentar a própria democracia.